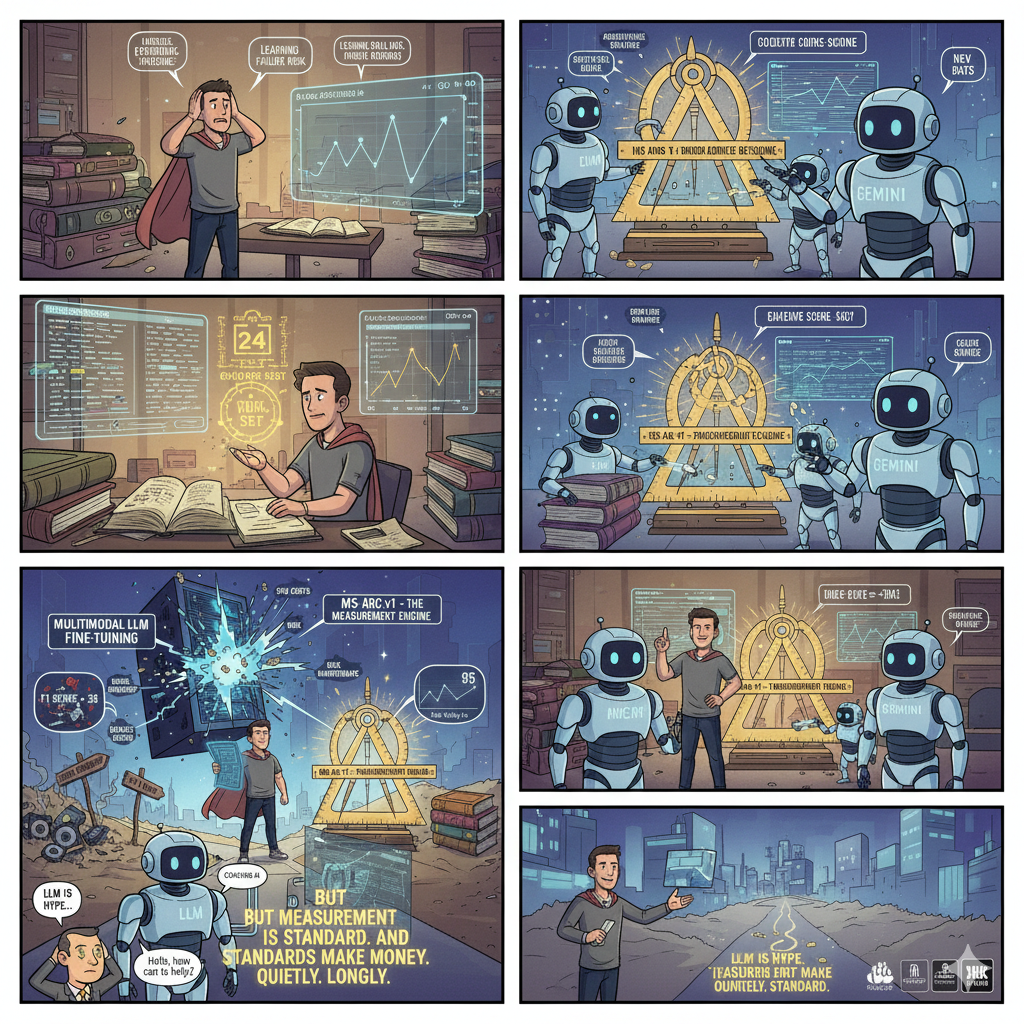

나는 왜 멀티모달 파인튜닝을 포기했는가

Why I Gave Up Multimodal Fine-Tuning처음에는 미스트랄이었다.

멀티모달 데이터셋을 만들고, 파인튜닝까지 직접 해봤다.

텍스트와 구조, 감정과 맥락을 함께 학습시키는 실험이었다.

결과는 나쁘지 않았다.

정합 점수는 85점.

“된다”는 감각은 분명히 있었다.

하지만 문제는 기술이 아니었다.

자원과 시간, 그리고 소유의 비용이었다.

It started with Mistral.

I built a multimodal dataset and even fine-tuned a model myself.

It was an experiment that trained text, structure, emotion, and context together.

The results weren’t bad.

The coherence score was 85.

I could clearly feel: “This can work.”

But the real problem wasn’t the technology.

It was resources, time, and the cost of ownership.

이 글은 “승리”가 아니라 “방향 전환”의 기록이다.

This is not about winning. It’s a record of changing direction.

모델을 소유한다는 것의 무게

The Weight of Owning a Model

모델을 소유하는 순간, 모든 것이 바뀐다.

The moment you decide to own a model, everything changes.

- GPU 비용 GPU costs

- 학습 실패 리스크 training failure risk

- 재학습을 위한 데이터 확장 data expansion for retraining

- 유지·관리·감가상각 maintenance, operations, depreciation

성능이 오를수록 비용은 선형이 아니라 기하급수적으로 증가한다.

그리고 나는 혼자였다.

그때 처음으로 현실적인 질문을 던졌다.

“이걸로… 어떻게 돈을 벌지?”

As performance rises, costs don’t grow linearly—they explode.

And I was building alone.

That’s when I asked the first realistic question:

“How do I actually make money with this?”

내가 가진 자산은 단 하나였다

I Had Only One Asset

내게 남은 자원은 9권짜리 책뿐이었다.

팔리지도 않았고, 인기도 없었다.

그래서 처음에는 이렇게 생각했다.

“이 책에서 데이터셋을 만들어 팔아볼까?”

나는 실제로 아마존에서 데이터셋 판매를 시도했다.

그런데 그 시도는 오래가지 못했다.

계정이 블락되면서, 판매를 시도조차 하지 못했다.

그 순간, 선택지가 갈라졌다.

“팔 수 없는 것”을 붙잡고 주저앉을 것인가,

아니면 “팔지 않아도 살아남는 것”을 만들 것인가.

그래서 질문이 바뀌었다.

“그럼 나는 이 책의 데이터를, 무엇으로 바꿀 수 있지?”

All I had left was a nine-volume book series.

It wasn’t popular. It didn’t sell.

So I thought:

“What if I turn my books into datasets and sell them?”

I actually tried to sell datasets on Amazon.

But the attempt didn’t last long.

The account was blocked, and I couldn’t even attempt to sell them.

At that moment, the road split in two:

Do I cling to what I can’t sell—

or do I build something that survives without selling datasets?

So the question changed:

“Then what can I turn this book-data into?”

감정 데이터와 서사 곡선, 그리고 골든 셋

Emotion Data, Narrative Arcs, and a Golden Set

나는 다시 책으로 돌아갔다.

그 안에서 감정 데이터와 서사 곡선(Peak–Valley Arc)을 뽑아냈다.

놀랍게도,

24개 에피소드 / 모든 정합성 100점 / 완전히 일치하는 골든 셋이었다.

이 데이터로 모델을 학습시켰다.

그리고 F1 점수를 냈다.

35점.

I returned to the books.

From them, I extracted emotion signals and a Peak–Valley narrative arc.

Surprisingly:

24 episodes / perfect alignment (100 coherence) / a fully consistent golden set.

I trained a model on that data and calculated the F1 score.

35.

35점짜리 AI 모델

A 35-Point AI Model

아무리 감마를 조정하고, OVR 임계값을 튜닝해도 결과는 바뀌지 않았다.

F1 35점짜리 머신러닝 기반 AI.

그때는 실패라고 생각했다.

하지만 지금은 안다.

그건 모델이 아니라 평가 방식의 문제였다는 걸.

나는 서사의 “짧은 단면”만 보고,

F1이라는 국소 지표로 전체 구조를 재단하고 있었다.

서사는 그렇게 측정되지 않는다.

No matter how I tuned gamma or adjusted OVR thresholds, the result didn’t change.

A machine-learning-based AI stuck at F1 = 35.

Back then, I called it failure. Now I know what it really was:

The problem wasn’t the model—it was the evaluation.

I was judging a global narrative structure using a local metric.

Narratives aren’t measured that way.

엔진을 만들다

So I Built an Engine

그래서 방향을 바꿨다.

모델을 더 키우는 대신, 엔진을 만들었다.

예측 결과를 해석하는 디코더.

규칙과 추론을 연결하는 구조.

단일 예측이 아닌 전체 서사 흐름을 보는 계측 방식.

그렇게 정합 점수를 다시 계산했을 때,

95점이 나왔다.

그제야 알았다.

이 모델은 분류기가 아니라 추론기였다는 걸.

I changed direction.

Instead of scaling the model, I built an engine:

A decoder that interprets predictions.

A structure that bridges rules and inference.

A measurement method that reads the whole arc, not a single point.

When I recalculated coherence, it reached 95.

That’s when I understood:

This wasn’t just a classifier. It was an inference engine.

LLM을 시험하다

Testing LLMs

궁금해졌다. 이 엔진은 인간이 아닌 존재의 글도 구분할 수 있을까?

GPT에게 단편 소설을 써달라고 했다.

결과는 100점. 두 번 연속.

구조적으로 완벽했다.

이번에는 Gemini에게 부탁했다.

84점.

이 실험은 감마·타우 민감도를 10포인트나 낮춘 상태에서 진행한 결과다.

글쓰기 생성 능력은 분명 GPT가 압도적이다. 이건 부정할 수 없다.

하지만 이 엔진은 말을 평가하지 않는다.

구조를 측정한다.

I wondered if it could distinguish non-human writing too.

I asked GPT to write a short story.

The result: 100. Twice in a row. Structurally perfect.

Then I asked Gemini.

84.

This was tested after lowering gamma/tau sensitivity by 10 points.

In generation, GPT is clearly dominant.

But this engine doesn’t judge “good writing.”

It measures structure.

그래서 나는 파인튜닝을 포기했다

Why I Gave Up Fine-Tuning

멀티모달 파인튜닝은 강력하다.

하지만 동시에 가장 비싼 선택이다.

내가 할 일은,

모델을 소유하는 것이 아니라 기준을 소유하는 것.

그래서 나는 LLM을 “말하는 도구”로 두고,

그 앞에 측정하는 AI를 두기로 했다.

그렇게 탄생한 것이 MS-Arc v1이다.

Multimodal fine-tuning is powerful—yet it’s the most expensive option.

My job wasn’t to own a model.

My job was to own the standard.

So I decided to keep LLMs as “speaking tools,” and place a measuring AI in front of them.

That’s how MS-Arc v1 was born.

끝으로

Closing이 글은 성공담이 아니다. 오히려 포기의 기록이다.

하지만 나는 이제 확신한다.

기준은 요란하지 않지만, 결국 비용을 줄이고 시간을 돌려준다.

This isn’t a success story. It’s a record of letting go.

But now I’m certain:

The standard isn’t loud—yet it reduces cost and gives time back.

기준은 소리 없이 남는다. 그리고 남는 것은, 결국 길이 된다.

The standard remains without noise. And what remains, becomes a path.

나는 박사가 아닌 작가라서, 오히려 비용과 재현성으로만 증명해야 했다.

그래서 나는 ‘소유’가 아니라 ‘기준’으로 갔다.

I’m not a PhD—I’m a writer. So I had to prove it with cost and reproducibility.

That’s why I chose a standard, not ownership.

Leave a comment